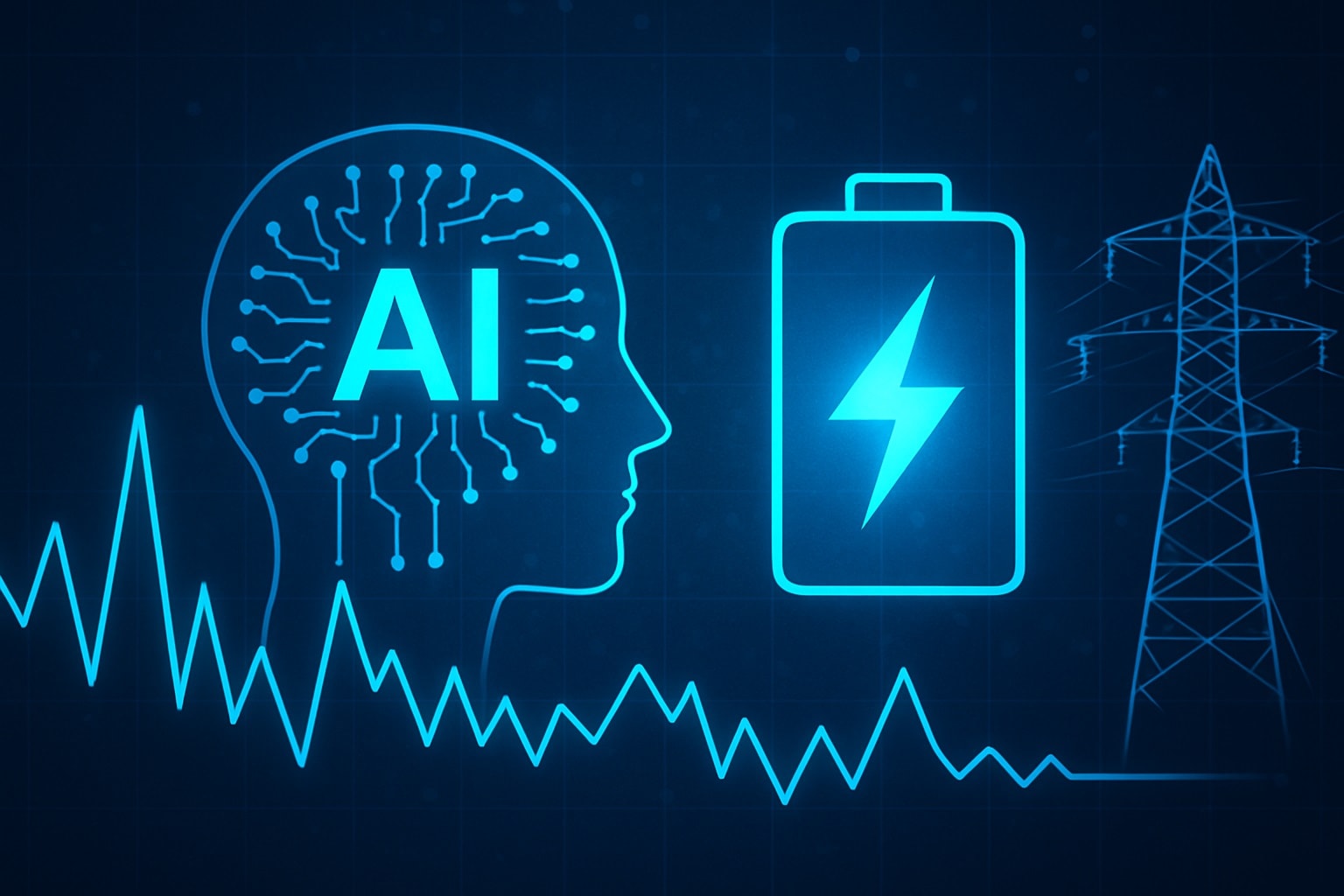

نماذج الاستدلال في الذكاء الاصطناعي تثير مخاوف حول الضغط على شبكات الكهرباء

أظهر بحث جديد أن نماذج الذكاء الاصطناعي القائمة على الاستدلال تستهلك طاقة تزيد بمئة مرة مقارنة بالنماذج التقليدية، ما يفاقم المخاوف من الضغط المتصاعد الذي يشكّله الذكاء الاصطناعي على شبكات الكهرباء حول العالم. الدراسة، التي نشرها مشروع AI Energy Score، وجدت أن هذه الأنظمة الحديثة المصممة لمحاكاة التفكير البشري , تحمل تكلفة طاقة ضخمة، في وقت تتوسع فيه شركات التكنولوجيا ببناء مراكز بيانات أكبر لتلبية الطلب المتزايد على قدرات الذكاء الاصطناعي.

وفقاً لمصادر بلومبيرغ اليوم , أظهر تقييم شمل 40 نموذجًا مفتوح المصدر من شركات مثل OpenAI وGoogle وMicrosoft وجود فجوات هائلة في استهلاك الطاقة بين النماذج التي تستخدم ميزة الاستدلال وتلك التي لا تستخدمها. فقد استهلك نموذج R1 من شركة DeepSeek الصينية 50 واط/ساعة فقط عند تعطيل الاستدلال، لكنه قفز إلى 308,186 واط/ساعة عند تفعيل هذه الميزة , أي زيادة تفوق ستة آلاف ضعف.

تأتي هذه النتائج في وقت تتزايد فيه الضغوط على شبكات الكهرباء، خصوصًا بالقرب من مراكز البيانات. وكان تحقيق سابق قد كشف أن أسعار الكهرباء بالجملة ارتفعت بما يصل إلى 267% خلال خمس سنوات في مناطق تضم مراكز بيانات ضخمة. كما أعربت شركات كبرى مثل Microsoft وGoogle وAmazon عن خشيتها من أن تؤثر توسعة البنية التحتية للذكاء الاصطناعي على قدرتها على تحقيق أهدافها المناخية.

كما تعود فكرة نماذج الاستدلال إلى أكثر من عام، عندما أطلقت OpenAI أول نموذج من هذا النوع تحت اسم o1، والذي يقدم إجابات أبطأ لكن أكثر تعقيدًا بفضل اعتماده على خطوات إضافية في الحساب. ومنذ ذلك الحين، اتجهت شركات عديدة إلى تطوير نماذج مشابهة قادرة على حل مشكلات متعددة المراحل في مجالات العلوم والرياضيات والبرمجة.

وبالإضافة , رغم اعتماد هذه النماذج بشكل واسع، فإن الدراسات المتعلقة باستهلاكها للطاقة لا تزال قليلة. ويشير الباحثون إلى أن السبب الرئيس في ارتفاع استهلاك الطاقة يعود إلى حجم النصوص الكبير التي تولدها هذه النماذج مقارنة بغيرها.

ووفقاً لبلومبيرغ , لقياس الفروقات، أجرى الباحثون الاختبارات على نفس العتاد الحاسوبي وبنفس قائمة الأسئلة، بدءًا من أسئلة تاريخية بسيطة وصولًا إلى مسائل حسابية معقدة، فيما تم تتبع استهلاك الطاقة باستخدام أداة CodeCarbon. وكشفت النتائج أن نموذج Phi 4 من Microsoft استهلك 9,462 واط/ساعة عند تشغيل الاستدلال مقابل 18 واط/ساعة فقط عند إيقافه، بينما سجل نموذج gpt-oss من OpenAI فارقًا أقل حدة بين وضعي الاستدلال "المرتفع" و"المنخفض".

ولم تستجب Google ولا Microsoft ولا OpenAI ولا DeepSeek لطلبات التعليق على نتائج التقرير.

ختاماً , كانت Google قد كشفت في آب/أغسطس عن نتائج داخلية تشير إلى أن الاستعلام الواحد على خدمتها Gemini يستهلك 0.24 واط/ساعة فقط، وهو ما يعادل تشغيل التلفاز لمدة تقل عن تسع ثوانٍ، معتبرةً أن هذه الأرقام أقل بكثير من التقديرات المنتشرة.